̸�������ĵ����Ż����ܴ�ʩ

һ����������

�й������������Ĵ�55������ֺĵ����أ�������졣

�й��Ʋ�ҵ��չ���ҹ滮ָ���������“�Ƽ���”���ֵ��ģ���ﵽ2000��Ԫ������IaaS�г���ģռ150��Ԫ���ƻ�����ʩ���ģ������Ҫ����Ϊ������SaaSϵͳ֧��;��Ӫ���������ݻ���;��У��������������;�������������ƽ���;������Ӧ�õ����ݴ洢(��֪����)��

�������Ļ���������һֱ����ʹ�û���ר�þ��ܿյ���Ϊ��Ҫ�����豸�����ż�����豸�ĸ��»�����IT�豸�Ĺ����ܶ�Խ��Խ�ߣ��������Խ��Խ����������Խ��Խ�࣬������ԴԽ��Խ���š���ȫ����Դ��������ͻ��������£���Ȼ�����յ�������Ч��������ߣ������ķѵĵ�����Ȼ̫�ߣ�һֱ�����Ż�����Ӫ�̺��û���

������������;��

��������µļ������ͻ������������ĵĵ��ܣ�������ɫ�����������ѳ�Ϊ������ҵ�������ǹ�ע�ĺ������⡣

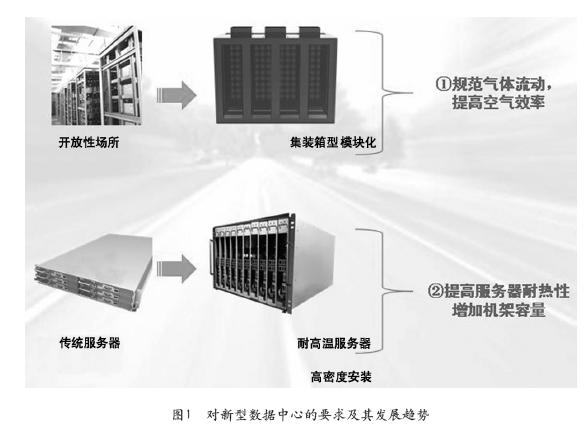

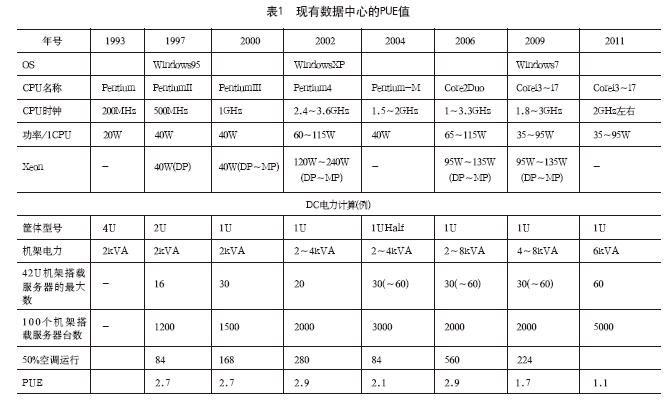

���ڴ�ͳ��������PUE�����2.0���ϣ�һ�����ϵĵ��ܱ��յ�ռ�á�

ӵ��һǧ̨���������������ģ����ܺĵ糬��1000��ȣ����յ���ռ��500��ȡ�

��Ŀǰ�����������ϵͱ����㣺

�������ĵ�(ȡ��ֵ��600w��1500w/̨)����ҵ�õ�≈1Ԫ/��

��������ĵ���(��)=��������×600W×24Сʱ×365��÷1000

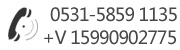

��������ģ�黯���������һ�������ʡ��ѿ��½�һ��������

��ҵ����Ϣ�������ļ�����ʽ“ʮ����”�ص�����?ͳ�ﲿ����ɫ�������Ľ��衣

��ʵ����ҵ����Ϣ������չ�ĸ�ί������Դ��������Դ�ֹ����������Ľ��貼�ֵ�ָ�������(���Ų���ͨ��2013��13��)���ٽ���������ѡַͳ�����Դ�ͻ������أ����������������⻯���������ݴ洢���Ƽ����¼������ƽ���Դ��Լ���ã��������ܼ���ˮƽ;

��̨��Ӧ��һ����ɫ��������Ҫ�����ر����Ż������������������֣����þ�ȷ�ͷ硢��Դ������ȴ�ȴ�ʩ���ӻ������衢���豸ѡ�͵ȷ��潵����Ӫ�ɱ���ȷ���½������������ĵ�PUEֵ�ﵽ1.5���£�����ʹ������������ĵ�PUEֵ�½���2���¡�

ȷ���½��������ĵ�PUEֵ��1.2��1.4֮�䣬�����������ĵ�PUEֵ��1.9����(һ�����ԭ��������PUEֵ�����ϵݼ�30%)��

�����������취

�������ķ���ȴ�ij�̬���ܴ�ʩ��Ҫ��ȡ���ͻ���ɢ�������ĵĵ��ܣ�����������Ļ����ĵ�Դʹ��Ч�ʣ��Ӷ�����IDC��PUEֵ��

Ŀǰ��Ҫ��7�ֳ�̬���ܴ�ʩ��

(1)���������Ļ����н�����ͨ�������������ͷ����ר�÷���ʽ���ܿյ���

(2)���������Ļ����н�����ͨ�������������ͷ����ר�÷���ʽ���ܿյ���

(3)���������Ļ����н���ר�÷���ʽ���ܿյ������ȷ�ܵ����Ի������ȫ�ܷ�ǿ��ɢ�ȡ�

(4)���������Ļ�����ʹ�����ͷ����ר�÷���ʽ���ܿյ��������ͷ����������羻ѹ�ֵ����ֱ���������

(5)���������Ļ������ô���ˮ��ʽ�������ܿյ���

(6)���������Ļ�������ר�ô���ˮ��ʽ�������ܿյ���оƬ��ȴ�ܵ���ֱ�Ӹ�IT�豸оƬɢ�ȡ�

(7)���������Ļ������û�������ʽ���ܿյ�+�����·��1��1���á�

��������һ����IDC��̬���ܴ�ʩ������������������ѷ���������������£�

����Դ����˵����1��2��3��4�־����Dz��û���ר�÷���ʽ���ܿյ���Ϊ��Դ����5��6�ֲ���ˮ��ʽ���ܿյ�����7�ֲ��÷���ʽ���ܿյ�����Ȼ����ˮģ��

ʹ�÷���ʽ���ܿյ��ڽ�Լ��������Ҫ�����յ���������Ч�ȣ���Ч����3-4֮�䣬���ܷ�������;ʹ��ˮ��ʽ���ܿյ�����Ч������ܴﵽ6��һ����4����;ʹ����Ȼ����·��ϵͳʱ�������Ч�ȿɴ�12��

�����豸����Ч����1��2��5��7�ֶ��������Դ����ƽ���ֲ�ɢ�ȣ�Ҫ�����������ķ���������Ҫ�dz����⣬������ܳ��ֻ������Ȳ������������ֲ����ȵ����⡣

��3�ֲ������������ǿ��ɢ�ȣ�ÿ�������ȳ���ܵ������з����ɢ��Ч���ã����׳��ֹ������䣬���Ҳ��Ҫ����һ���ĵ��ܡ�

��4�ֲ�����Ҫ�豸�����������ñ��ٷ������̬�������ṩ��磬�Ϻý���ֲ�����������Ⱥͻ������ȸ���ͻȻ��������⣬���������¶���ߵ��յ��Ļط��¶ȣ����������ȱ���ͨ�������Ҫ��100�O�������Ҫ���ĵ��ܡ�

��6�ֲ��þ�ɢ�ȣ���оƬɢ��Ч���ã�����Դ��Ӳ�̵Ȳ����辫ɢ�Ȳ�����ʵʩ����Ҫ����������֧�֡�

�����豸ɢ�Ƚ������׳ɶȵ�1��2��4��7�ֱȽϽӽ����ȴ�ͳ���ͷ�յ�ϵͳ������һ�㣬����ʵʩ���ɱ����Ҳ����

��3�֣���Ҫ�Ի���ǰ���Ž����ܷ⣬ʵʩ���ѣ���ܽ���Ƚ϶࣬�Ի��������岼����Ӱ�죬��Ҫ�dz�ϸ�µĹ滮����ƣ��ɱ����Ҫ��һЩ��

��5�֣�ˮ��յ��Ľ����ż��ϸߣ��Ƚ������ڴ��͵Ļ������յ��豸�ȷ���ʽ���ܿյ�Ҫ���ӣ��ɱ����Ҫ��һЩ������Ҳ��Ҫרҵά����Ա��

��6�֣��յ����ݺ͵�5��һ�������Ƿ�֧����ܵ����棬����Ը��Ӻܶ࣬Ҫ�dz��˽���������̵��豸�Ľṹ����������Ҫ���ǵ�֧�֣��ɱ�������Ի�߳�һ���ݡ�

�ġ�������

�ɹ���Ʋ������˵��ܺġ����¡����ܼ��ȷ�������Ⱥ���߳��ػ��ܣ�����������������ϵͳ���ڲ����廷������ϵͳ;ʵ��������Ȼ��Դ�����ͳ�յ��豸ά�����ݻ�����ʪ�ȣ��ڱ�֤���������������ɿ����е�ͬʱ���������ĵ��ܺ���Ȼ�ͻ��������͡�

�ؼ��Dz���������������IT�豸�����ʴ����ߺͲ������¿ؼ���������£�����ܹ�ʹ�������ĺ��ܽϴ�ͳ���ݻ��������ʡ60%���ң�ʹ���ܼ���Ч��һ����λ����Щ��Ȼ��Ҫ���Dz��ϲ��ù���ǰ�ؼ�����������������ͨ���淶���������ڲ�������֯���������������;ͨ��ģ�黯���췽ʽ��ʵ���������Ĺ�ģ������չ����С�������ij�ʼͶ��;ͨ�����弴�õĻ���ģ���Ʒ�����̽������ڣ���߹�������;�������ս���������ĵ����е������Ĵ��������Ľ������ڳ��������������Ա�֤����Լ����“�Ƽ���”��“������”��ҵ��չ����Ҫ���⡣